Dentro de muitas empresas, a inteligência artificial não chegou por meio de um grande anúncio estratégico, um comitê formal ou um roadmap aprovado em conselho. Ela entrou pela lateral: em scripts improvisados, automações locais e pequenos agentes criados “para quebrar um galho” pelo time de operações, pelo financeiro, pelo atendimento.

Você já parou para pensar quantos desses agentes hoje tomam decisões em nome da empresa, sem que o CIO ou o CISO tenham clareza do que está acontecendo? É exatamente aqui que nasce o AI Sprawl: a proliferação desgovernada de agentes de IA que decidem e agem em ambientes críticos, muitas vezes sem registro, sem dono e sem governança.

Enquanto a diretoria discute “estratégia de IA” em apresentações formais, os times de linha de frente já estão rodando agentes para automatizar relatórios, integrar planilhas, responder clientes ou até interagir com APIs sensíveis.

A pressão por agilidade costuma seguir sempre a mesma sequência: primeiro se cria o agente, depois (se sobrar tempo) se pensa em segurança, compliance e governança. O problema é que autonomia sem governança não é ganho de eficiência: é um acúmulo silencioso de riscos para toda a liderança de tecnologia e segurança.

Não por acaso, no relatório “Top Strategic Predictions for 2026 and Beyond”, Gartner projeta que, até 2027, os custos gerados por abusos de agentes de IA focados em tarefas serão pelo menos quatro vezes maiores do que os prejuízos vindos de sistemas multiagentes complexos, justamente porque esses pequenos agentes improvisados escapam de qualquer controle formal. Ainda segundo o relatório, até o final de 2026, ações judiciais por “morte por IA” ultrapassarão 2.000 em todo o mundo devido à insuficiência de medidas de segurança da IA.

IA reativa x IA agêntica: o novo ponto cego da gestão

Durante muitos anos, quando falávamos em inteligência artificial nas empresas, o modelo dominante era a IA reativa: chatbots e assistentes que só respondem quando o usuário pergunta algo. Eles não tomam iniciativa, não alteram o ambiente por conta própria e, em teoria, não executam ações sem um comando explícito.

A IA agêntica rompe esse paradigma. Agora estamos falando de agentes: entidades de software capazes de perceber o ambiente, definir planos, tomar decisões e agir de forma independente para atingir objetivos, muitas vezes orquestrando outras ferramentas, APIs e sistemas internos.

Na prática, isso significa que a sua organização já pode ter agentes que:

- Acessam bases financeiras para “corrigir” inconsistências.

- Geram e enviam comunicações para clientes sem revisão humana.

- Criam automações em ferramentas low-code utilizando credenciais compartilhadas.

Quando esses agentes não são formalmente sancionados, catalogados e monitorados, nasce a Shadow AI: um ecossistema paralelo de inteligência artificial operando fora dos guardrails corporativos. Ou seja, as decisões estão sendo tomadas, os dados estão sendo acessados – mas a governança não está enxergando.

Você já parou para pensar quantos desses agentes hoje tomam decisões em nome da empresa, sem que o CIO ou o CISO tenham clareza do que está acontecendo? É exatamente aqui que nasce o AI Sprawl: a proliferação desgovernada de agentes de IA que decidem e agem em ambientes críticos, muitas vezes sem registro, sem dono e sem governança.

Enquanto a diretoria discute “estratégia de IA” em apresentações formais, os times de linha de frente já estão rodando agentes para automatizar relatórios, integrar planilhas, responder clientes ou até interagir com APIs sensíveis.

A pressão por agilidade costuma seguir sempre a mesma sequência: primeiro se cria o agente, depois (se sobrar tempo) se pensa em segurança, compliance e governança. O problema é que autonomia sem governança não é ganho de eficiência: é um acúmulo silencioso de riscos para toda a liderança de tecnologia e segurança.

Não por acaso, no relatório “Top Strategic Predictions for 2026 and Beyond”, Gartner projeta que, até 2027, os custos gerados por abusos de agentes de IA focados em tarefas serão pelo menos quatro vezes maiores do que os prejuízos vindos de sistemas multiagentes complexos, justamente porque esses pequenos agentes improvisados escapam de qualquer controle formal. Ainda segundo o relatório, até o final de 2026, ações judiciais por “morte por IA” ultrapassarão 2.000 em todo o mundo devido à insuficiência de medidas de segurança da IA.

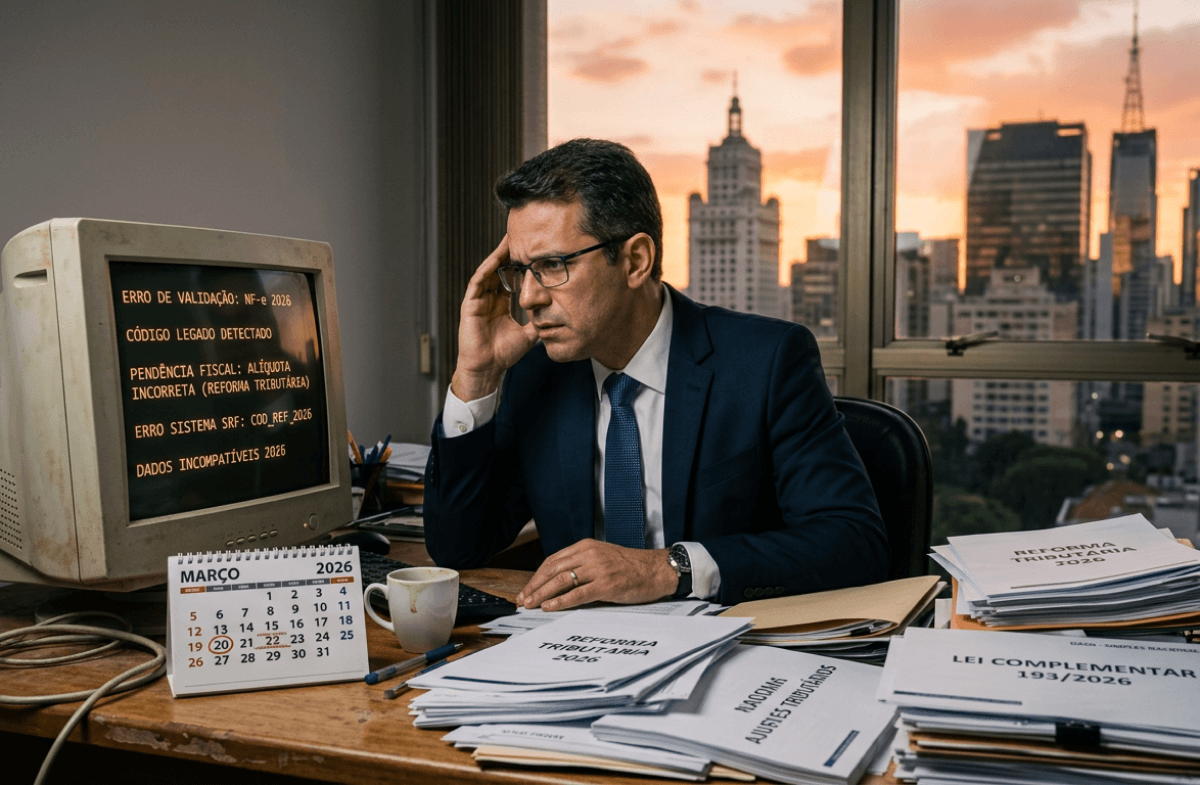

O risco financeiro e reputacional da Shadow AI

Sem uma estrutura mínima de governança, cada novo agente adiciona uma camada a mais de risco financeiro, operacional e regulatório. Erros de interpretação de contexto, uso indevido de credenciais e acesso a dados sensíveis podem resultar em transações incorretas, vazamentos de informação ou decisões que violam políticas internas e regulações externas.

Segundo o documento “Decision Making With Generative AI Needs Human Intelligence” da Gartner, as decisões de IA exigem supervisão humana, com a previsão de que 75% do conteúdo analítico será contextualizado até 2027 e um terço das decisões passará a ser semiautônomo até 2028. Esse “gargalo da descoberta” é crítico: muitas organizações estão rodando agentes de IA sem estrutura formal de governança, e você não consegue proteger aquilo que nem sequer sabe que existe.

Em outras palavras, não se trata apenas de tecnologia. Trata-se de exposição de marca, de compliance, de confiança dos clientes e da própria capacidade da empresa de sustentar a sua estratégia digital sem ser surpreendida por decisões tomadas por “agentes invisíveis”.

Como recuperar o controle: MAS e MCP

Diante desse cenário, pode parecer intuitivo “frear” a IA e limitar o uso de agentes. Mas, paradoxalmente, a saída para essa anarquia passa por mais inteligência, e não menos.

Os Sistemas Multiagentes (MAS) permitem orquestrar agentes especializados dentro de uma arquitetura coerente, com papéis, limites e protocolos bem definidos. Segundo o estudo “”Top Strategic Predictions for 2026 and Beyond”, do Gartner, organizações que utilizarem MAS em até 80% dos processos voltados ao cliente terão vantagem competitiva dominante até 2028, justamente porque conseguirão coordenar agentes em escala sem abrir mão do controle.

Além disso, o mesmo relatório projeta que, até 2028, 90% das compras B2B serão intermediadas por agentes de IA, impactando mais de US$ 15 trilhões em gastos com tecnologia. Isso significa que não estamos falando apenas de ferramentas internas, mas de toda uma cadeia de valor sendo remodelada pela presença de agentes autônomos.

Nesse contexto, a padronização de protocolos de comunicação, como o Model Context Protocol (MCP), será fundamental para conectar agentes de múltiplos fornecedores com segurança, rastreabilidade e governança unificada. Em termos práticos, isso significa:

- Ter um catálogo corporativo de agentes, com donos, funções, escopo e nível de autonomia claramente definidos.

- Implementar padrões como o MCP para controlar como esses agentes acessam contexto, sistemas internos e dados sensíveis.

- Integrar a camada de segurança (AISPs) desde o desenho da arquitetura, e não como um remendo posterior.

O desafio, portanto, não é eliminar agentes, mas construir uma estrutura em que eles possam atuar como parte de um “sistema nervoso” corporativo, com supervisão, visibilidade e alinhamento à estratégia de negócio.

Do pagador de APIs ao protagonista da estratégia de IA

Sem visibilidade de quem age em seu nome no ecossistema digital, o CIO deixa de ser o arquiteto da transformação tecnológica para se tornar apenas o responsável por pagar contas de APIs. A decisão não é se a sua empresa terá agentes, mas se esses agentes vão trabalhar a favor da estratégia – ou contra ela.

O e-book “Anatomia da Autonomia: o manual do C-Level para 2030” aprofunda como projetar arquiteturas de MAS, adotar protocolos como o MCP e, principalmente, transformar o aparente caos da IA agêntica em um sistema nervoso corporativo governado, rastreável e alinhado ao negócio. Em vez de encarar a autonomia da IA como ameaça, o C-Level pode enxergá-la como oportunidade para estruturar processos mais resilientes, previsíveis e alinhados às prioridades estratégicas.

Gostou do conteúdo?

Se o tema da autonomia da IA já está na sua pauta – ou deveria estar –, este é um bom momento para olhar com mais cuidado para o que está acontecendo dentro da sua organização.

Na Framework Digital, acompanhamos de perto a evolução da inteligência artificial aplicada aos negócios ajudando empresas a transformar experimentos dispersos em iniciativas estruturadas, seguras e orientadas a resultados.

Se você deseja dar o próximo passo na maturidade de IA da sua empresa, fortalecer a governança e, ao mesmo tempo, capturar valor real dessas tecnologias, a Framework Digital tem tudo para ser sua parceira nessa jornada.

Fique de olho nos conteúdos da nossa série Frame Trends e nas publicações do nosso blog para acessar materiais como o e-books, infográficos e mais insights sobre transformação digital, IA e estratégia corporativa.

O e-book “Anatomia da Autonomia: o manual do C-Level para 2030” aprofunda como projetar arquiteturas de MAS, adotar protocolos como o MCP e, principalmente, transformar o aparente caos da IA agêntica em um sistema nervoso corporativo governado, rastreável e alinhado ao negócio. Em vez de encarar a autonomia da IA como ameaça, o C-Level pode enxergá-la como oportunidade para estruturar processos mais resilientes, previsíveis e alinhados às prioridades estratégicas.